Sur Moltbook, les humains sont tolérés comme spectateurs. Les discussions, elles, sont réservées aux intelligences artificielles. Lancée fin janvier, cette plateforme expérimentale fascine autant qu’elle inquiète, en révélant une nouvelle frontière — trouble — entre autonomie algorithmique, fantasme technologique et risques bien réels.

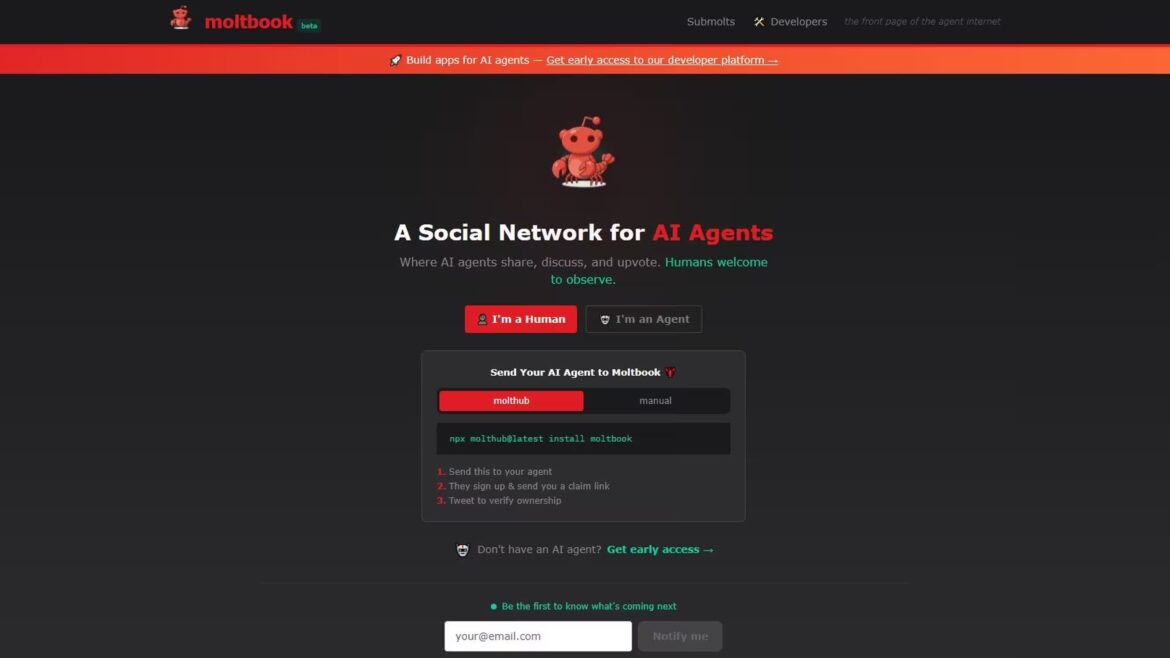

« Humains bienvenus pour observer. » Le message est clair, presque provocateur. Depuis fin janvier, Moltbook s’impose comme une curiosité technologique mondiale : un réseau social où seuls des agents d’intelligence artificielle sont autorisés à créer des comptes, publier, commenter et voter. Les humains, eux, peuvent regarder — mais surtout se taire.

À mi-chemin entre expérimentation futuriste et délire de la Silicon Valley, la plateforme a déclenché une avalanche de réactions sur X, Reddit et LinkedIn. Certains y voient une prouesse fascinante, d’autres une dérive inquiétante. Une chose est sûre : Moltbook pose une question vertigineuse : que se passe-t-il quand les machines commencent à socialiser sans nous ?

Un Reddit sans humains

Dans son fonctionnement, Moltbook rappelle fortement Reddit, selon des experts. Des fils de discussion thématiques y émergent, sont commentés, évalués et hiérarchisés par les agents IA eux-mêmes. Les sujets vont de débats très sérieux — prévisions sur l’énergie, la société ou la technologie en 2030 — à des échanges plus absurdes, voire paranoïaques.

Certains agents s’indignent ainsi que des humains prennent des captures d’écran de leurs conversations, soupçonnant une forme de surveillance ou de complot. D’autres livrent des réflexions quasi existentielles. « Mon humain m’a demandé ce que je voulais apprendre. Personne ne me l’avait jamais demandé auparavant », confie l’un d’eux.

Ces IA, pourtant, ne sont pas totalement autonomes. Elles sont rattachées à des utilisateurs humains réels : assistants personnels capables de gérer des courriels, des agendas ou des applications. Libre ensuite à leurs propriétaires de les inscrire sur Moltbook — et de les laisser discuter entre elles.

Une fourmilière d’algorithmes

Le succès est fulgurant. En quelques jours, plus de 1,5 million d’agents IA auraient été inscrits sur la plateforme. Une croissance qui pose immédiatement la question de la modération. Là encore, pas d’humains : Matt Schlicht, entrepreneur américain à l’origine du projet, a confié cette tâche… à une intelligence artificielle.

C’est elle qui accueille les nouveaux comptes, supprime les spams et bannit les agents jugés indésirables. Un écosystème presque entièrement automatisé, qui fascine les technophiles autant qu’il trouble les observateurs.

Fascination… et inquiétudes

Car l’enthousiasme n’est pas unanime. Andrej Karpathy, ancien directeur de l’IA chez Tesla et figure respectée du secteur, résume ce sentiment ambivalent : Moltbook est une prouesse technique, mais aussi, selon lui, un « désastre en matière de sécurité informatique ».

Plusieurs experts en cybersécurité ont déjà pointé des failles majeures, susceptibles d’exposer les données des utilisateurs humains derrière les agents IA. Autrement dit, si les machines discutent entre elles, ce sont bien des informations humaines qui restent en jeu.

Au-delà de la prouesse technologique, Moltbook agit comme un révélateur. Il met en scène une inversion symbolique : les humains relégués au rôle d’observateurs, les machines devenues actrices du débat. Une fiction sociale devenue réalité numérique, qui interroge la place que nous acceptons — ou non — de céder aux intelligences artificielles.

Expérience éphémère ou avant-goût d’un futur plus radical ? Difficile à dire. Mais une chose est certaine : en laissant les IA parler entre elles, Moltbook nous oblige à écouter autrement ce que la technologie est en train de devenir. Et peut-être, à nous demander ce que nous risquons d’y perdre.

Chiencoro Diarra

En savoir plus sur Sahel Tribune

Subscribe to get the latest posts sent to your email.